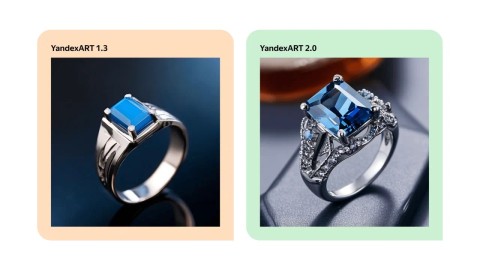

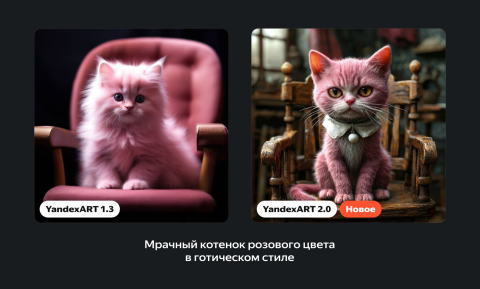

Компания «Яндекс» представила новую диффузионную нейросеть YandexART 2.0. Благодаря переходу на новую гибридную архитектуру, она стала гораздо лучше и точнее генерировать изображения. Разработчики рассказали, как они обучали нейросеть и какие технологии применяли для её улучшения.

«Новая модель умеет создавать надписи прямо на изображениях, придерживаться нескольких стилей на одной картинке, располагать объекты в пространстве и относительно друг друга более естественно и учитывать при генерации больше деталей из текстового запроса», — рассказал Евгений Ляпустин из команды компьютерного зрения «Яндекса».

По словам Евгения, ранее они использовали классический вариант свёрточной архитектуры U-Net, применяемой в DALL-E 2, Imagen и других популярных нейросетях. Разработчики экспериментировали с трансформерами (Stable Diffusion 3 и FLUX), которые позволяют учитывать длинный контекст, но результат их не удовлетворил. В итоге они создали собственную гибридную архитектуру, объединяющую достоинства свёрточного и трансформерного подхода. Как результат, YandexART теперь умеет использовать сразу нескольких стилей в одном изображении. Например, можно сгенерировать фотореалистичную банку лимонада, на этикетке которой будет аниме-персонаж.

Большим достижением разработчики считают возможность нейросети генерировать на изображениях полноценные слова. Пока это работает только на латинице, но в скором времени они намерены внедрить поддержку и кириллицы.

YandexART 2.0 уже доступна на облачной платформе Yandex Cloud. С помощью API разработчики могут интегрировать её в свои приложения. Кроме того, нейросеть уже доступна в новом приложении «Алиса».